LaMDA -LaMDA

LaMDA , que significa Language Model for Dialogue Applications , é uma família de modelos de linguagem neural conversacional desenvolvida pelo Google . A primeira geração foi anunciada durante a palestra do Google I/O de 2021 , enquanto a segunda geração foi anunciada no evento do ano seguinte. Em junho de 2022, o LaMDA ganhou ampla atenção quando o engenheiro do Google, Blake Lemoine, afirmou que o chatbot havia se tornado senciente . A comunidade científica rejeitou amplamente as alegações de Lemoine, embora tenha levado a conversas sobre a eficácia do teste de Turing , que mede se um computador pode passar por um humano.

História

Anúncios

O Google anunciou o modelo de linguagem neural conversacional LaMDA durante a palestra do Google I/O em 18 de maio de 2021, alimentado por inteligência artificial . Construído com base na arquitetura de rede neural Transformer desenvolvida pela Google Research em 2017, o LaMDA foi treinado em diálogo e histórias humanas, permitindo que ele se envolvesse em conversas abertas. O Google afirma que as respostas geradas pelo LaMDA foram garantidas como "sensatas, interessantes e específicas para o contexto".

Em 11 de maio de 2022, o Google apresentou o LaMDA 2, que serve como sucessor do LaMDA, durante a palestra do Google I/O de 2022. A nova revisão do modelo extrai exemplos de texto de várias fontes, usando-o para formular "conversas naturais" únicas sobre tópicos que podem não ter sido treinados para responder. Além disso, o Google lançou o AI Test Kitchen, um aplicativo móvel desenvolvido com LaMDA 2 capaz de fornecer listas de sugestões sob demanda com base em um objetivo complexo. Originalmente aberto apenas para funcionários do Google, o aplicativo será disponibilizado para "selecionados acadêmicos, pesquisadores e formuladores de políticas" por convite em algum momento do ano.

Reivindicações de senciência

Em 11 de junho de 2022, o Washington Post informou que o engenheiro do Google Blake Lemoine havia sido colocado em licença administrativa remunerada depois que Lemoine disse aos executivos da empresa Blaise Agüera y Arcas e Jen Gennai que o LaMDA havia se tornado consciente . Lemoine chegou a essa conclusão depois que o chatbot deu respostas questionáveis a perguntas sobre identidade própria , valores morais , religião e as Três Leis da Robótica de Isaac Asimov . O Google refutou essas alegações, insistindo que havia evidências substanciais para indicar que o LaMDA não era senciente. Em entrevista à Wired , Lemoine reiterou suas alegações de que LaMDA era "uma pessoa" conforme ditado pela Décima Terceira Emenda , comparando-a a uma "inteligência alienígena de origem terrestre". Ele revelou ainda que havia sido demitido pelo Google depois de contratar um advogado em nome da LaMDA, depois que o chatbot solicitou que Lemoine o fizesse.

As alegações de Lemoine foram amplamente rejeitadas pela comunidade científica. Gary Marcus , um professor de psicologia da Universidade de Nova York , denunciou-os como "absurdos em palafitas" e enfatizou que LaMDA não tinha sentimentos ou autoconsciência . David Pfau, da empresa irmã do Google, DeepMind , e Erik Brynjolfsson , do Instituto de Inteligência Artificial Centrada no Homem da Universidade de Stanford, ridicularizaram a ideia de que um modelo de linguagem pudesse ser senciente. Yann LeCun , que lidera a equipe de pesquisa de IA da Meta Platforms , afirmou que redes neurais como LaMDA "não eram poderosas o suficiente para atingir a verdadeira inteligência". O professor da Universidade da Califórnia, em Santa Cruz , Max Kreminski, observou que a arquitetura do LaMDA não "suportava algumas capacidades-chave da consciência humana" e que seus pesos de rede neural estavam "congelados", assumindo que era um modelo típico de grande linguagem, enquanto a Universidade de Surrey o professor Adrian Hilton declarou a afirmação de que o LaMDA era senciente uma "afirmação ousada" não apoiada pelos fatos. O desenvolvedor líder do IBM Watson , David Ferrucci , comparou como o LaMDA parecia ser humano da mesma forma que o Watson fez quando foi introduzido pela primeira vez. O ex-eticista de IA do Google , Timnit Gebru, chamou Lemoine de vítima de um "ciclo de hype" iniciado por pesquisadores e pela mídia. As alegações de Lemoine também geraram discussão sobre se o teste de Turing permaneceu útil para determinar o progresso dos pesquisadores em direção à inteligência artificial geral , com Will Omerus, do Post , opinando que o teste realmente mediu se os sistemas de inteligência de máquina eram capazes de enganar os humanos.

Método

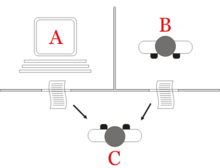

O LaMDA usa um modelo de linguagem de transformador somente decodificador. Ele é pré-treinado em um corpus de texto que inclui documentos e diálogos que consistem em 1,56 trilhão de palavras e, em seguida, é treinado com dados de ajuste fino gerados por respostas anotadas manualmente para sensatez, interesse e segurança. Testes do Google indicaram que o LaMDA superou as respostas humanas na área de interesse. O modelo de transformador LaMDA e um sistema externo de recuperação de informações interagem para melhorar a precisão dos fatos fornecidos ao usuário.

Três modelos diferentes foram testados, com o maior com 137 bilhões de parâmetros não incorporados:

| Parâmetros | Camadas | Unidades ( modelo d ) | Cabeças |

|---|---|---|---|

| 2B | 10 | 2560 | 40 |

| 8B | 16 | 4096 | 64 |

| 137B | 64 | 8192 | 128 |

Veja também

- IA do Google

- argumento do quarto chinês

- Processamento de linguagem natural

- Filosofia da inteligência artificial

Referências

Em geral

-

Thoppilan, Romal; De Freitas, Daniel; Salão, Jamie; Shazeer, Noam; Kulshreshtha, Apoorv; Cheng, Heng-Tze; Jin, Alicia; Bos, Taylor; Baker, Leslie; Du, Yu; Li, YaGuang; Lee, Hongrae; Zheng, Huaixiu Steven; Ghafouri, Amin; Menegali, Marcelo; Huang, Yanping; Krikun, Maxim; Lepikhin, Dmitry; Qin, James; Chen, Dehao; Xu, Yuanzhong; Chen, Zhifeng; Roberts, Adam; Bosma, Maarten; Zhao, Vicente; Zhou, Yanqi; Chang, Chung-Ching; Krivokon, Igor; Rusch, Will; Pickett, Marc; Srinivasan, Pranesh; Homem, Laichee; Meier-Hellstern, Kathleen; Ringel Morris, Meredith; Doshi, Tulsee; Delos Santos, Renelito; Duque, Toju; Soraker, Johnny; Zevenbergen, Ben; Prabhakaran, Vinodkumar; Diaz, Marcos; Hutchinson, Ben; Olson, Kristen; Molina, Alejandra; Hoffman-John, Erin; Lee, Josh; Aroyo, Lora; Rajakumar, Ravi; Butryna, Alena; Lamm, Mateus; Kuzmina, Viktoriya; Fenton, Joe; Cohen; Arão; Bernstein, Rachel; Kurzweil, Ray; Aguera-Arcas, Blaise; Cui, Claire; Croak, Mariana; Chi, Ed; Le, Quoc (20 de janeiro de 2022). "LaMDA: Modelos de linguagem para aplicativos de diálogo" (PDF) . arXiv . arXiv : 2201.08239 . Arquivado do original em 21 de janeiro de 2022 . Recuperado em 12 de junho de 2022 .

{{cite journal}}:Cite journal requer|journal=( ajuda )